GDPR e AI Act per Startup e SaaS: Guida 2026

Compliance GDPR e AI Act per Startup/SaaS italiane (2026). Istruzioni su obblighi legali, DPA, DPO, Cookie mode e strategie per agenzie digitali.

Ordine degli Avvocati di Sciacca n. 747 · Avvocato & Sviluppatore · IT Law

Cosa rischiano concretamente startup SaaS e software house italiane nel 2026 tra GDPR e AI Act?

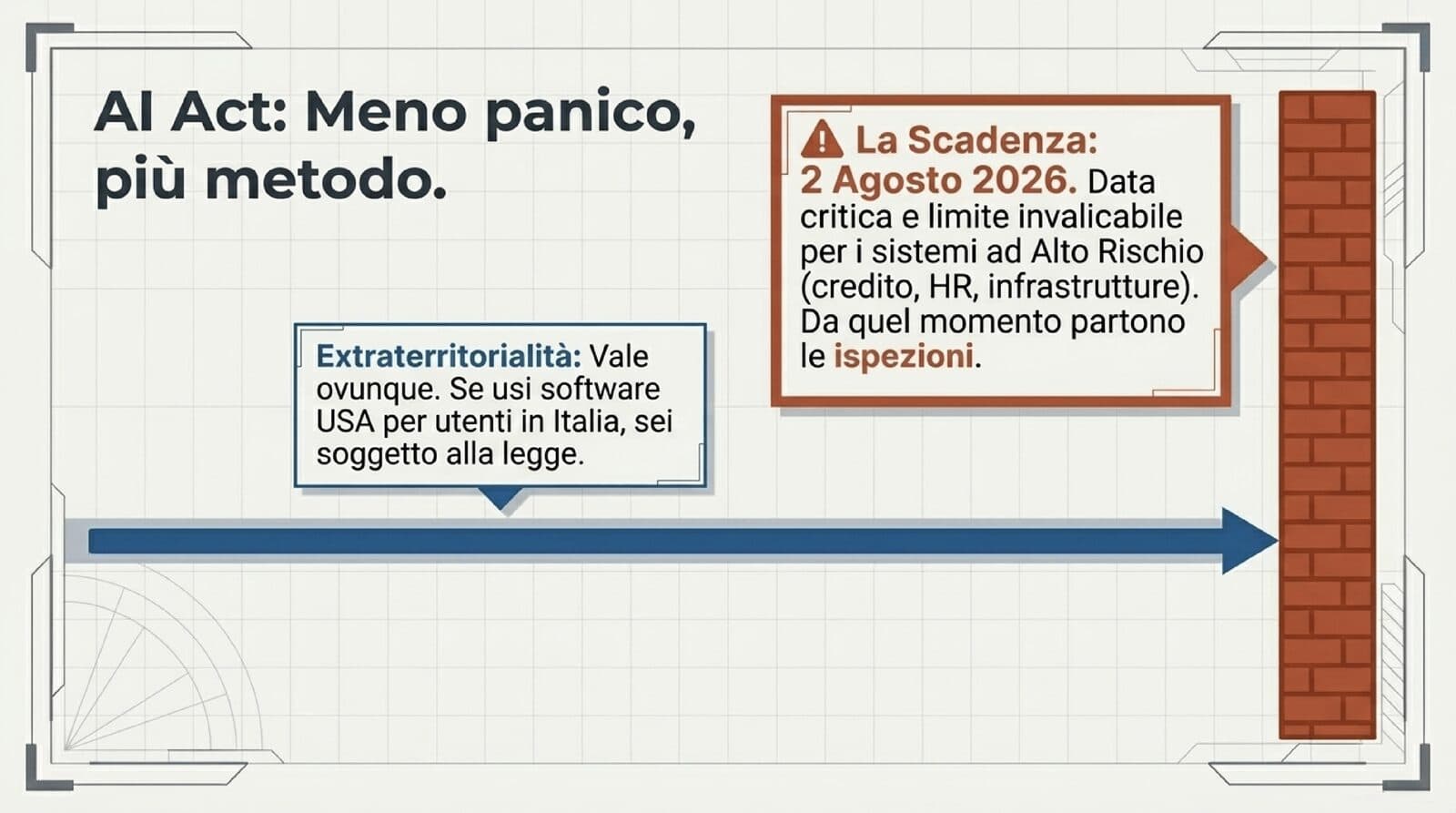

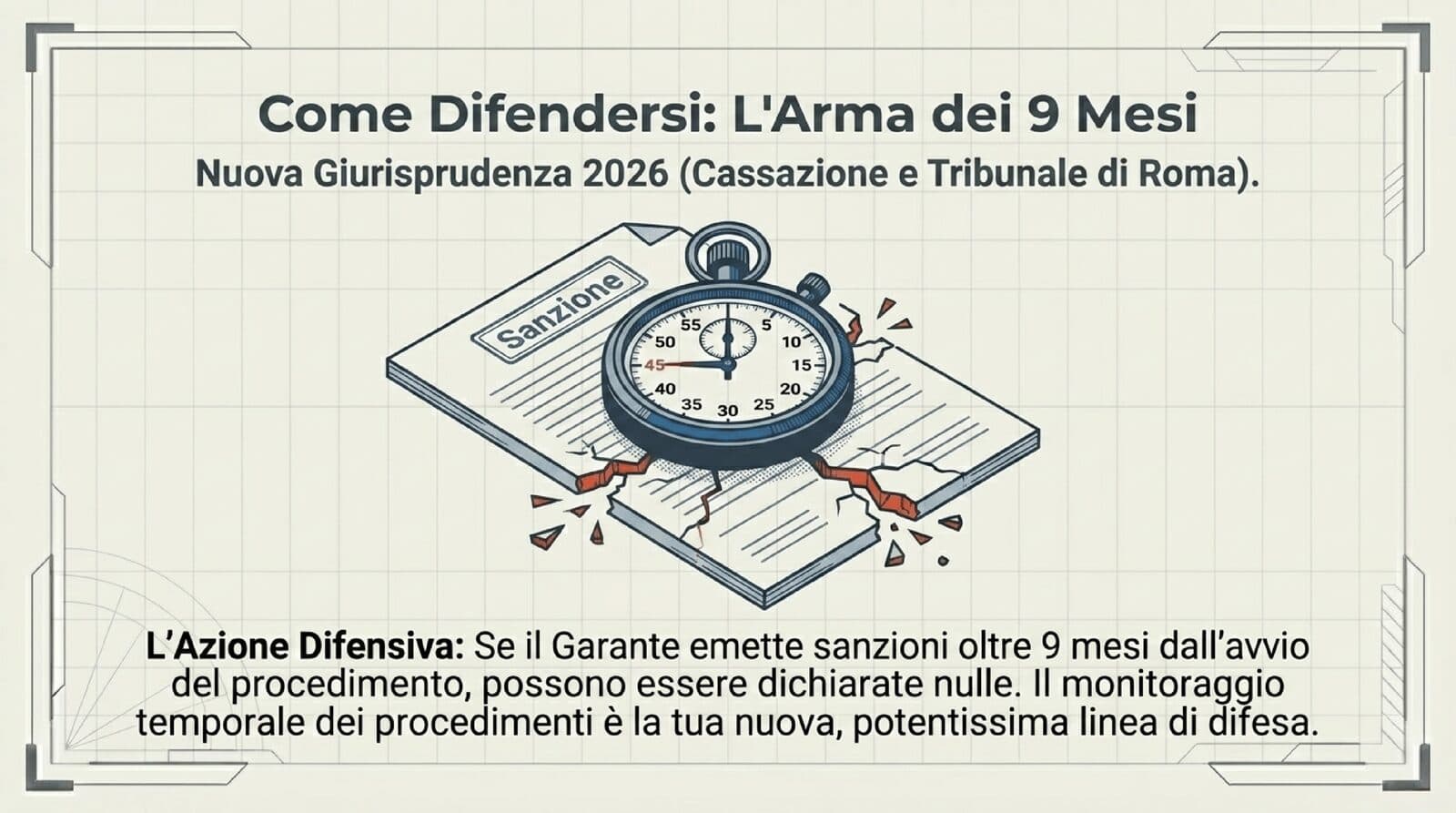

Le aziende tecnologiche italiane che sviluppano o utilizzano sistemi AI sono soggette simultaneamente a GDPR e AI Act, con sanzioni che si cumulano: fino a 20 milioni di euro per violazioni GDPR (Art. 83.5) e fino a 35 milioni di euro per violazioni AI Act (pratiche vietate). Il 2 agosto 2026 segna la piena applicabilità degli obblighi per i sistemi ad alto rischio. Ignorare il ruolo di Deployer AI Act o operare senza DPA firmato con i clienti B2B sono i due errori più sanzionati nel 2025-2026.

Nel panorama digitale del 2026, la tutela dei dati personali ha abbandonato definitivamente lo statuto di onere burocratico per diventare un elemento strutturale del modello di business. Per le startup che sviluppano piattaforme SaaS, per le software house e per le agenzie di marketing digitale italiane, questo cambiamento non è teorico: si traduce in obblighi concreti, audit da parte dei clienti enterprise nei round di investimento, e un quadro sanzionatorio che — tra GDPR e AI Act — ha raggiunto dimensioni storiche.

Nel 2025, le multe GDPR in Europa hanno superato 1,1 miliardi di euro su oltre 300 provvedimenti. In Italia, la sanzione più emblematica degli ultimi anni — i 27,8 milioni di euro irrogati a TIM per marketing aggressivo e gestione illecita dei consensi — ha dimostrato che nessuna dimensione aziendale è al riparo dall'attività ispettiva. Parallelamente, il 2 agosto 2026 segna la scadenza più critica dell'AI Act: la piena applicabilità degli obblighi per i sistemi di intelligenza artificiale classificati ad alto rischio.

Fonti primarie: Reg. UE 2016/679 (GDPR) — EUR-Lex · Reg. UE 2024/1689 (AI Act) — EUR-Lex · Legge 23 settembre 2025, n. 132 — Gazzetta Ufficiale · Garante Privacy — garanteprivacy.it

Questa guida analizza i cinque errori GDPR più sanzionati per le aziende tecnologiche italiane, gli obblighi AI Act 2026 per Deployer e Provider, le strategie di compliance per SaaS B2B, e il ruolo del DPO come asset strategico — non come formalità documentale. Per una panoramica completa degli adempimenti, consulta la guida all'adeguamento GDPR startup.

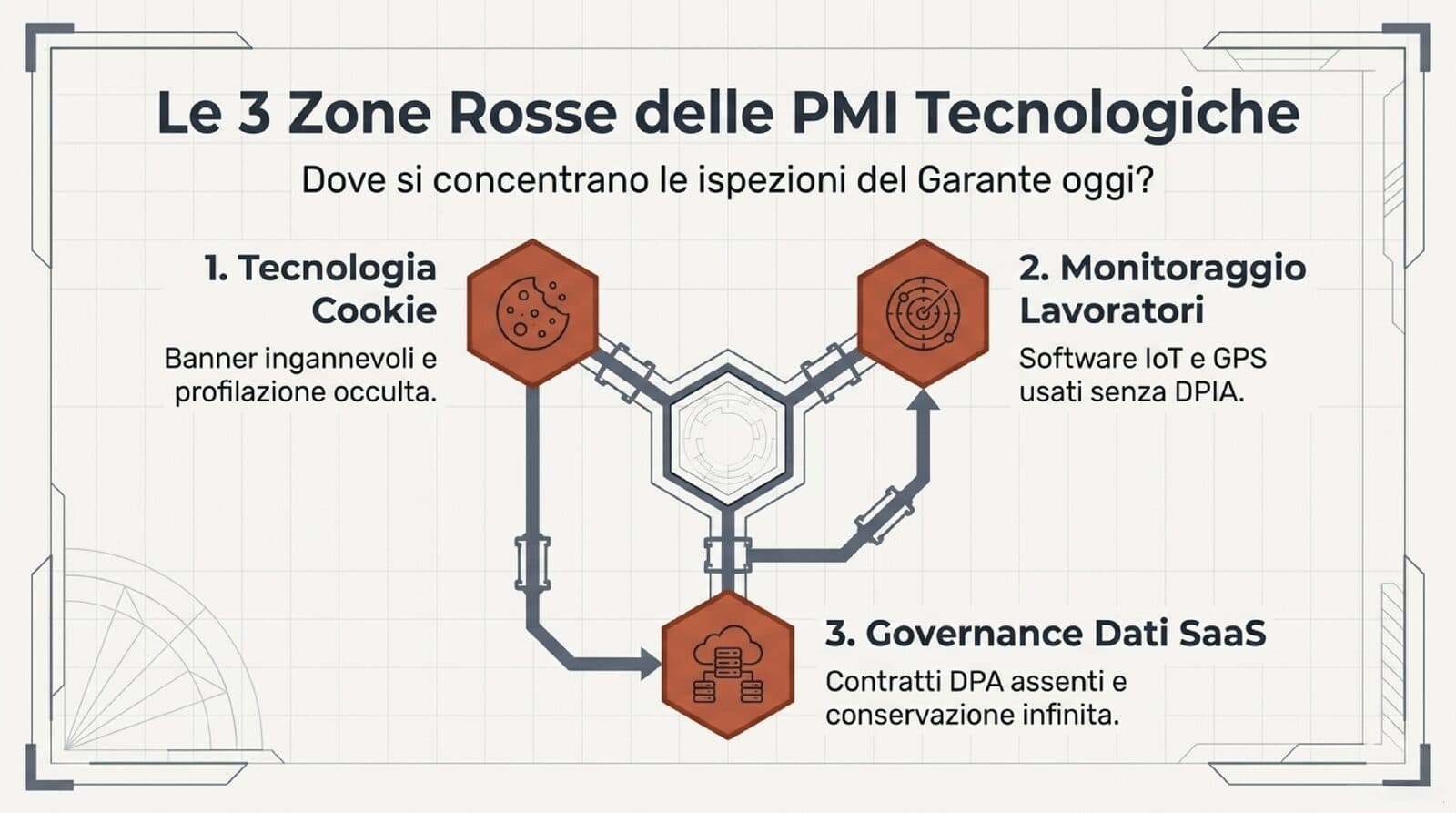

Quali sono gli errori GDPR più sanzionati dal Garante Privacy per le aziende tech nel 2024-2025?

L'analisi delle 835 delibere collegiali della Relazione Annuale 2024 del Garante Privacy (luglio 2025) evidenzia pattern ricorrenti nelle violazioni delle aziende tecnologiche:

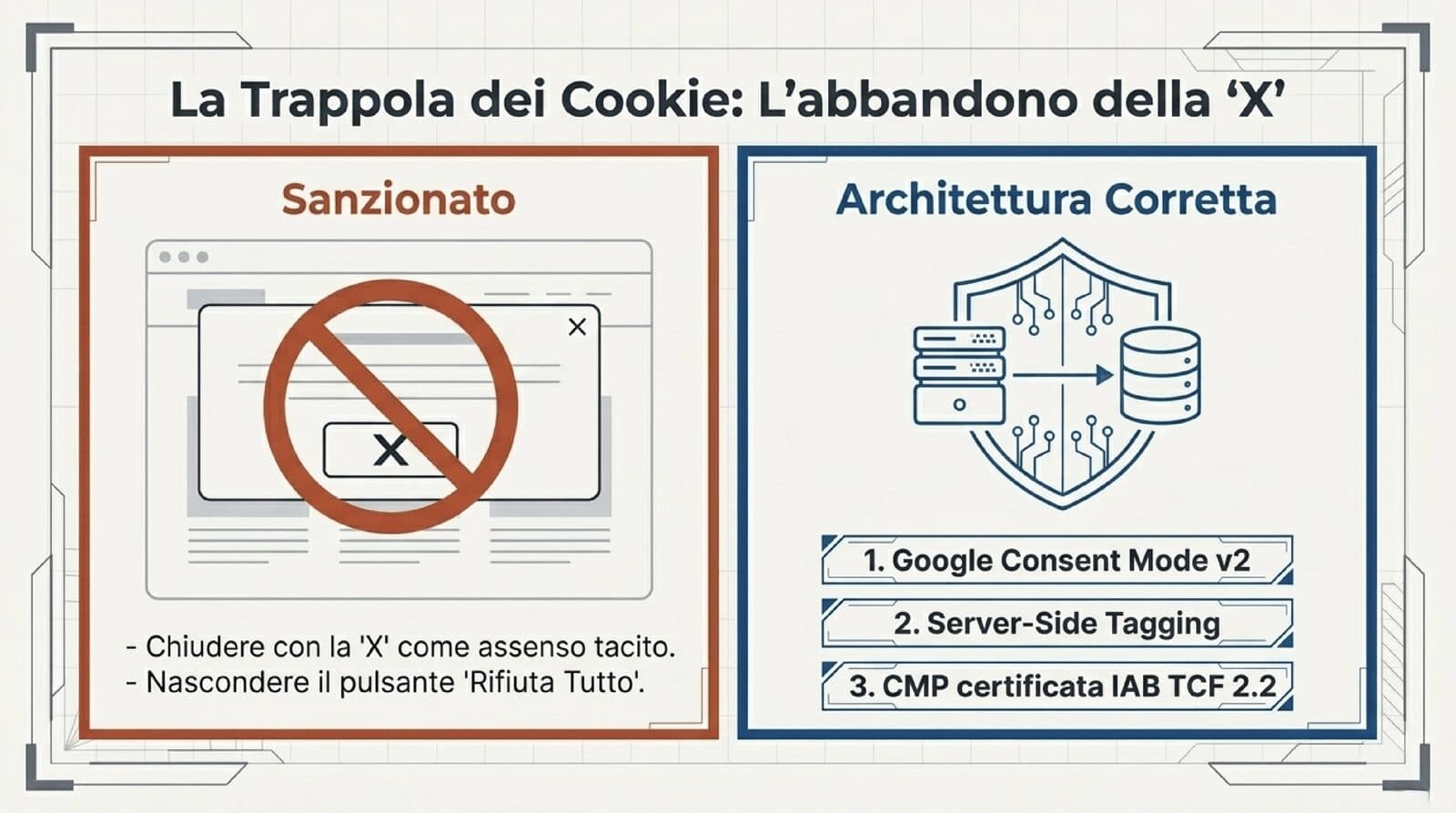

1. Cookie banner non conformi e dark pattern

Il Garante ha sanzionato ripetutamente i siti che adottano tecniche di design ingannevole (dark pattern) per ottenere consensi impropri:

- Chiusura banner con "X" = accettazione: il sito ripropone il banner a ogni accesso successivo come se l'utente non avesse mai interagito. Viola Art. 4(11) e 7 GDPR e Linee Guida Garante 10/06/2021.

- Impossibilità di rifiuto granulare: il banner permette l'accettazione in un clic ma richiede 3-4 passaggi per rifiutare. Viola il principio di equivalenza delle Linee Guida 2021.

- Pre-spuntamento delle caselle di consenso per analytics e profilazione: Art. 7.2 GDPR vieta espressamente il consenso "pre-impostato".

La soluzione tecnica più efficace è l'implementazione della Google Consent Mode v2, che permette di ottenere analisi web conformi anche in assenza di consenso (modellizzazione statistica), basandosi sull'Art. 6.1.f GDPR per il legittimo interesse nella misurazione anonimizzata dell'audience.

Nella consulenza a startup con funnel di acquisizione a pagamento, l'implementazione corretta della Consent Mode ha permesso di recuperare l'80-90% del dato di conversione che andava perso dopo l'introduzione del consenso obbligatorio, senza violare alcun obbligo normativo.

2. Monitoraggio dei lavoratori con tecnologie IoT senza DPIA

Un provvedimento del 2026 ha irrogato 120.000 euro di sanzione a una società che monitorava costantemente lo stile di guida di cinque dipendenti con auto aziendali, raccogliendo parametri sproporzionati rispetto alle finalità operative dichiarate.

Il perimetro di rischio si è esteso a:

- Software di fleet management con geolocalizzazione continua

- Strumenti di employee monitoring per il lavoro da remoto (screenshot, keystroke logging)

- Sistemi IoT per la misurazione delle performance in magazzino o nella logistica

L'obbligo preventivo, prima dell'implementazione di qualsiasi tecnologia di monitoraggio, è la DPIA (Valutazione d'Impatto, Art. 35 GDPR) integrata con la verifica del rispetto dell'Art. 4 dello Statuto dei Lavoratori (L. 300/1970 come modificato dal D.Lgs. 151/2015). Il trattamento dei dati di monitoraggio non può essere avviato senza:

- Accordo sindacale (per i sistemi che permettono il controllo a distanza) o autorizzazione INL

- Informativa specifica ai lavoratori

- Limitazione dei dati raccolti al minimo necessario (principio di minimizzazione, Art. 5.1.c GDPR)

3. DPA assenti nella catena contrattuale SaaS

L'Art. 28 GDPR impone la stipula di un Data Processing Agreement (DPA) ogni volta che un titolare del trattamento affida operazioni su dati personali a un soggetto esterno. Per una startup SaaS che elabora i dati dei clienti business, l'omissione del DPA configura una doppia violazione:

- Il cliente (titolare) viola l'Art. 28 per non aver nominato il responsabile

- La startup (responsabile) viola l'Art. 28 per aver operato senza incarico formale

In sede di due diligence nei round di investimento Series A e B, l'assenza di DPA firmati con i clienti è diventata un blocco frequente: i fondi richiedono documentazione di compliance come condizione per il closing.

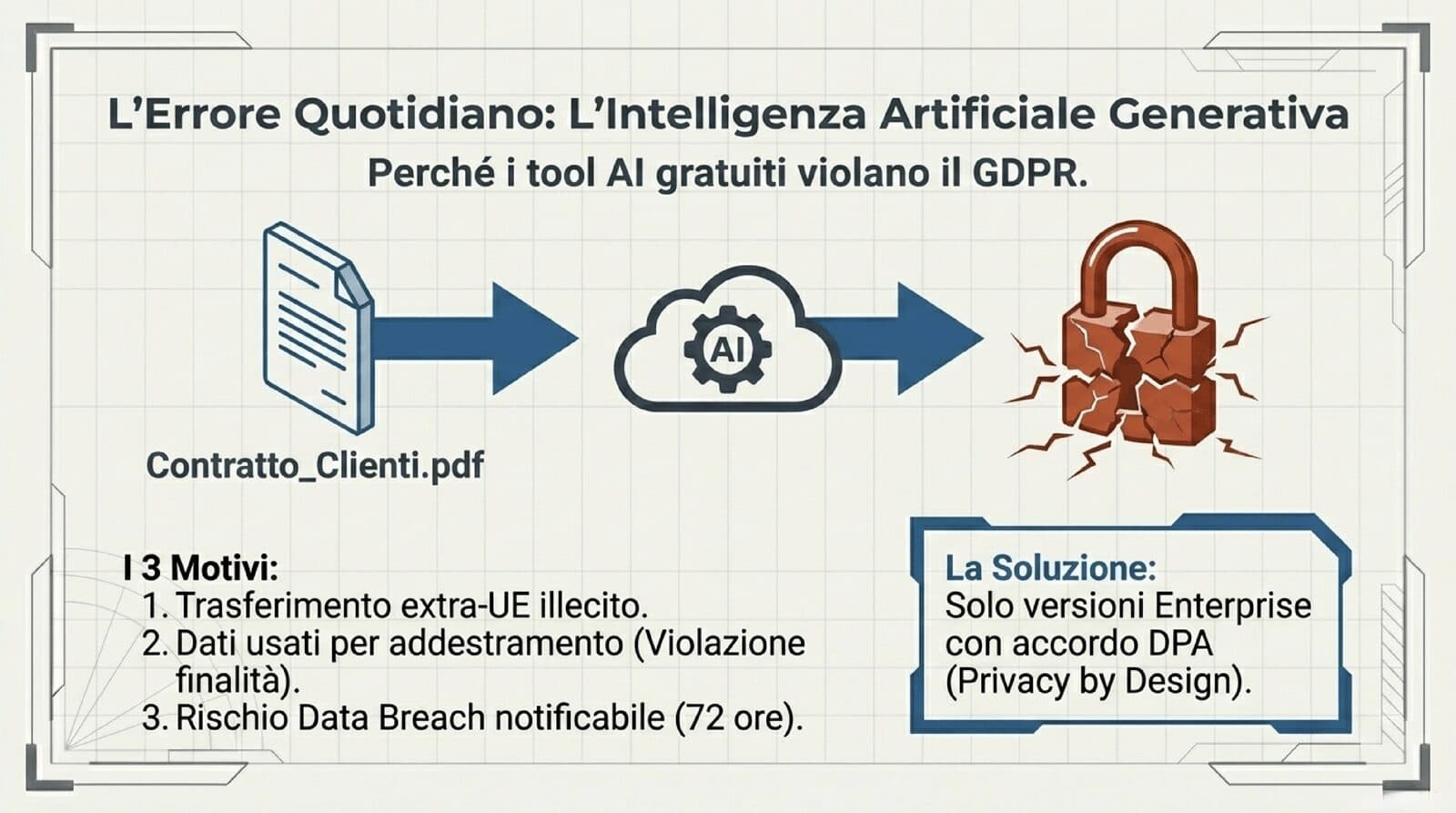

4. Uso incauto di AI generativa con dati aziendali o di clienti

Inserire materiale aziendale sensibile — anagrafiche clienti, dati contrattuali, informazioni mediche o brevetti — nelle versioni gratuite dei principali LLM (ChatGPT, Gemini, Claude nella versione consumer) configura:

- Un trasferimento illecito di dati extra-UE (violazione Capitolo V GDPR) verso server americani

- Un potenziale data breach ai sensi dell'Art. 4.12 GDPR, con obbligo di notifica al Garante entro 72 ore se i dati sono personali e il rischio è valutabile

- Una violazione del segreto professionale in caso di dati coperti da NDA o da obblighi di riservatezza

La soluzione operativa è l'adozione di versioni enterprise dei tool AI (con DPA firmato e dati non usati per il training) o di modelli on-premise che non trasmettono dati verso server terzi.

5. Privacy policy generiche copiate da template

L'informativa privacy di una piattaforma SaaS deve descrivere i trattamenti reali del servizio: le categorie di dati raccolti, le finalità specifiche, la catena dei sub-processori (es. AWS, Stripe, SendGrid), i trasferimenti extra-UE documentati. Un template generico produce un'informativa che non riflette i trattamenti effettivi, rendendo impossibile la difesa in caso di ispezione o reclamo.

Cosa prevede l'AI Act 2026 per le aziende italiane che usano o sviluppano sistemi di intelligenza artificiale?

L'AI Act (Reg. UE 2024/1689), con la sua applicazione per fasi, raggiunge il momento più critico per le aziende nel 2026:

| Scadenza | Obbligo | Soggetti coinvolti |

|---|---|---|

| 2 febbraio 2025 | Divieto sistemi vietati (Art. 5), alfabetizzazione AI personale (Art. 4) | Tutti i soggetti |

| 2 agosto 2025 | Obblighi modelli GPAI (Art. 53-55), governance AI Office UE | Provider modelli fondazionali |

| 2 agosto 2026 | Conformità completa sistemi ad alto rischio (Allegati I e III) | Provider e Deployer sistemi alto rischio |

| 2 agosto 2027 | Conformità sistemi alto rischio già in uso prima del 2026 | Deployer sistemi preesistenti |

Quali sistemi AI sono classificati "ad alto rischio" e impattano le PMI italiane?

L'Allegato III dell'AI Act include sistemi AI che le PMI e le software house italiane sviluppano o integrano quotidianamente senza consapevolezza del loro status normativo:

- Sistemi di screening e selezione del personale (HR tech, ATS automatizzati): alto rischio

- Credit scoring e valutazione del merito creditizio (fintech, piattaforme lending): alto rischio

- Sistemi di valutazione scolastica (ed-tech): alto rischio

- Diagnostica medica automatizzata (med-tech): alto rischio

- Sistemi biometrici per il riconoscimento di volti, emozioni o categorizzazione: alto rischio o vietati

Nel confronto con CTO di startup italiane, emerge spesso una sottovalutazione: un sistema di screening automatico dei CV che filtra i candidati prima della revisione umana è un sistema ad alto rischio ai sensi dell'Allegato III. Molte startup HR tech non se ne sono ancora rese conto.

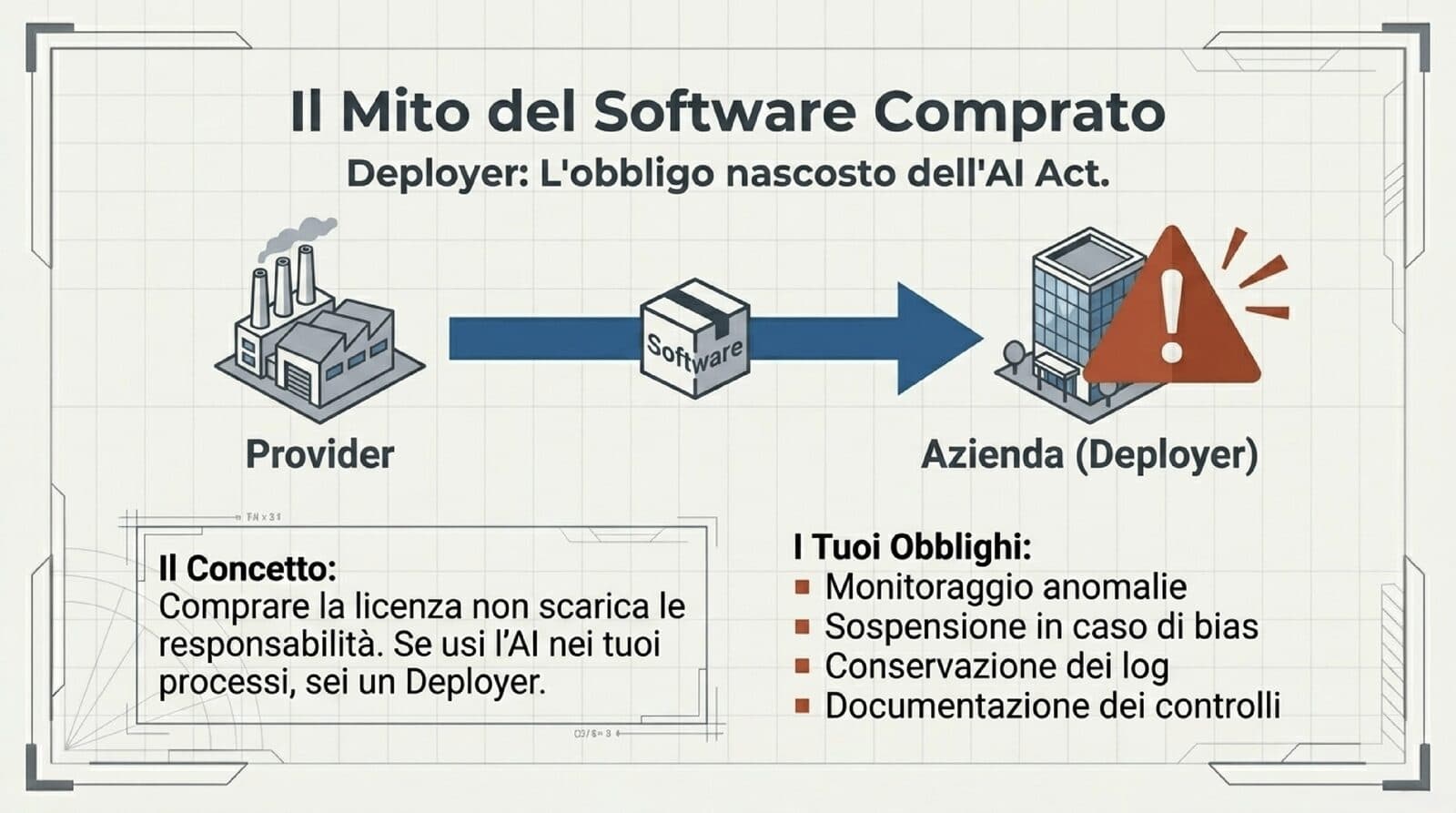

Chi è il Deployer AI Act e perché è responsabile anche se non sviluppa l'AI?

La distinzione tra Provider (chi sviluppa il sistema AI) e Deployer (chi lo utilizza) è uno dei punti più sottovalutati dall'ecosistema aziendale italiano. Il Deployer — ovvero qualsiasi azienda che integra soluzioni AI di terze parti nei propri processi — ha responsabilità proprie e non si "protegge" con il solo contratto d'acquisto.

Obblighi del Deployer per sistemi ad alto rischio:

- Verificare che il sistema sia conforme AI Act prima dell'implementazione

- Usare il sistema in conformità alle istruzioni del Provider

- Monitorare le performance nel tempo per identificare anomalie o bias

- Garantire la supervisione umana (human-in-the-loop) per le decisioni rilevanti

- Sospendere l'uso del sistema se emergono violazioni dei diritti fondamentali

- Mantenere log e documentazione dell'utilizzo

In caso di violazione, le sanzioni colpiscono sia il Provider sia il Deployer:

- Violazione delle pratiche vietate (Art. 5): fino a 35 milioni di EUR o 7% del fatturato

- Mancato rispetto degli obblighi per sistemi ad alto rischio: fino a 15 milioni di EUR o 3% del fatturato

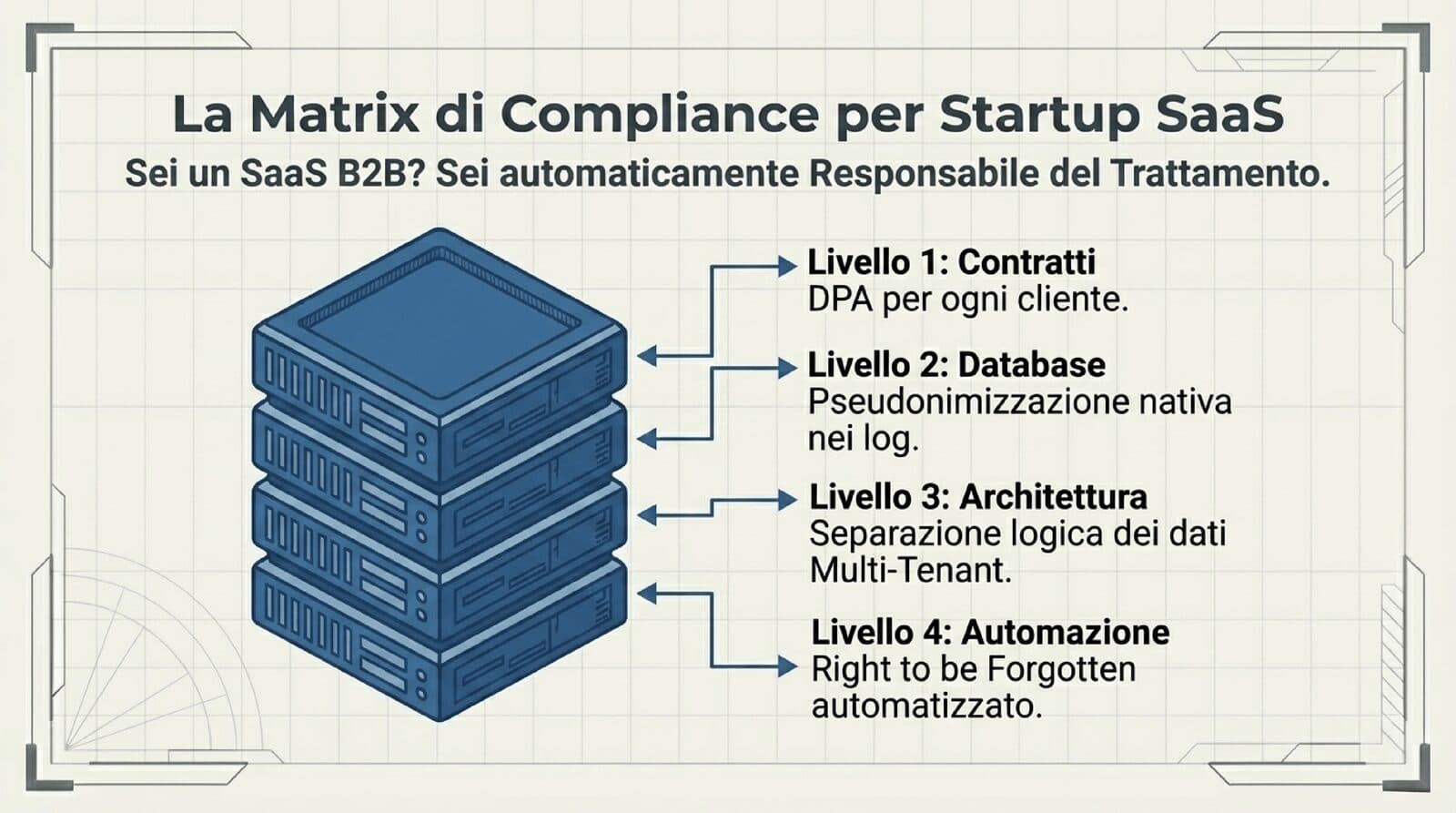

Come devono strutturarsi le startup SaaS per essere conformi come Responsabili del Trattamento?

Una startup SaaS che elabora dati per conto di clienti business assume la qualifica formale di Responsabile del Trattamento (Data Processor) ai sensi dell'Art. 28 GDPR. Questo implica un set documentale e procedurale specifico.

Il Data Processing Agreement (DPA) conforme all'Art. 28 GDPR

Il DPA è il contratto obbligatorio tra il cliente (Titolare) e la startup SaaS (Responsabile). Deve contenere:

| Elemento obbligatorio | Riferimento | Contenuto |

|---|---|---|

| Oggetto e durata del trattamento | Art. 28.3 GDPR | Descrizione del servizio e dei dati trattati |

| Natura e finalità del trattamento | Art. 28.3.a | Per quali scopi il Responsabile opera |

| Categorie di dati e di interessati | Art. 28.3.a | Chi sono gli utenti e quali dati vengono trattati |

| Istruzioni del Titolare al Responsabile | Art. 28.3.a | Indicazioni su come trattare i dati |

| Obblighi di riservatezza del personale | Art. 28.3.b | NDA o accordi con i dipendenti che accedono ai dati |

| Misure di sicurezza (Art. 32) | Art. 28.3.c | Crittografia, pseudonimizzazione, backup, access control |

| Condizioni per sub-responsabili | Art. 28.3.d-e | Lista dei sub-processor e meccanismo di autorizzazione |

| Assistenza al Titolare per diritti degli interessati | Art. 28.3.f | Come la startup gestisce richieste di accesso, cancellazione |

| Restituzione o cancellazione dei dati a fine contratto | Art. 28.3.g | Cosa succede ai dati quando il cliente rescinde |

| Audit e ispezioni | Art. 28.3.h | Diritto del Titolare di verificare la compliance |

Pratica commerciale: I grandi clienti enterprise richiedono sempre più spesso una Standard Information Security Questionnaire (SISQ) o un report di compliance come condizione per firmare il contratto. Avere un DPA strutturato e certificazioni di sicurezza (es. ISO 27001, SOC 2 Type II) riduce significativamente i tempi di onboarding.

La mappa dei sub-processori e i trasferimenti extra-UE

Una startup SaaS tipica utilizza decine di servizi terzi che accedono ai dati degli utenti finali: cloud provider, strumenti di invio email, sistemi di pagamento, analytics. Ognuno di essi è un sub-processore che deve essere:

- Elencato nel DPA (o in un allegato aggiornabile)

- Coperto da un DPA tra la startup e il sub-processore

- Verificato per la conformità ai trasferimenti extra-UE (SCCs, DPF per i fornitori USA)

Tutti i principali cloud provider americani (AWS, Google Cloud, Microsoft Azure) sono certificati EU-US Data Privacy Framework o offrono SCCs integrate nel loro accordo DPA. Verificare l'esistenza del DPA firmato e la data di ultimo aggiornamento è la prima verifica da fare in sede di audit.

L'automazione dei diritti degli interessati (DSAR)

Le piattaforme SaaS moderne devono integrare funzionalità native per la gestione delle Data Subject Access Requests (DSAR):

- Portale di export dati accessibile dall'utente: consente la portabilità ex Art. 20 GDPR

- Funzione di cancellazione account: garantisce il diritto all'oblio ex Art. 17 GDPR

- Strumenti di rettifica: permette la correzione dei dati personali ex Art. 16 GDPR

L'assenza di questi strumenti non è solo un problema di compliance: genera costi operativi elevati quando le richieste devono essere gestite manualmente dai team legali e tecnici.

AI Act e GDPR si applicano insieme: quando una startup è soggetta a entrambi?

Ogni volta che un sistema di intelligenza artificiale tratta dati personali, si applicano contemporaneamente GDPR e AI Act. La startup che sviluppa o utilizza sistemi AI deve gestire entrambi i framework in modo integrato.

I punti di intersezione più rilevanti per le aziende tech

| Scenario | Obbligo GDPR | Obbligo AI Act |

|---|---|---|

| Sistema AI per selezione del personale | DPIA obbligatoria (Art. 35) + informativa agli interessati (Art. 13) | Classificazione alto rischio + supervisione umana (Art. 14) |

| Chatbot che raccoglie dati utente | Informativa (Art. 13) + base giuridica (Art. 6) | Disclosure "stai interagendo con un AI" (Art. 50) |

| Sistema di credit scoring automatico | Diritto di opposizione alle decisioni automatizzate (Art. 22) | Alto rischio, documentazione tecnica (Art. 11) |

| Facial recognition o biometria | Dati particolari (Art. 9), base giuridica rafforzata | Alto rischio o vietato (Art. 5) |

| AI generativa che processa testi utente | DPA con il provider LLM + informativa sui dati inviati | Obblighi GPAI provider se fornisce modello (Art. 53) |

Nota operativa: Quando si adotta un sistema AI di terze parti (es. un LLM API per la funzionalità di ricerca intelligente del prodotto), la startup è Deployer AI Act e Titolare del trattamento dei dati personali degli utenti che interagiscono con il sistema. Le due responsabilità coesistono e non si elidono.

Cos'è la DPIA per sistemi AI e quando è obbligatoria?

La DPIA (Data Protection Impact Assessment, Art. 35 GDPR) è obbligatoria ogni volta che il trattamento "può presentare un rischio elevato" per i diritti e le libertà delle persone fisiche. Per i sistemi AI, il Garante Privacy e l'EDPB indicano che la DPIA è obbligatoria in presenza di:

- Profilazione automatizzata che produce effetti significativi sulla persona

- Trattamento su larga scala di dati particolari (salute, orientamento sessuale, dati biometrici)

- Monitoraggio sistematico di aree pubbliche o di dipendenti

- Decisioni automatizzate senza supervisione umana che impattano su persone fisiche

La DPIA deve documentare: la descrizione del trattamento, la valutazione della necessità e proporzionalità, i rischi individuati, le misure adottate per mitigarli. Non è un documento da compilare una volta sola: va aggiornata ogni volta che cambiano le finalità, le tecnologie o il contesto.

Come funziona la conformità al GDPR per il marketing digitale conforme nel 2026?

Il marketing digitale è l'area con la maggior densità di ispezioni per le aziende italiane. La convergenza tra cookie management, analytics, email marketing e targetingpubblicitario genera una cascata di obblighi che molte PMI e agenzie sottovalutano.

Cookie Consent Mode: come fare analytics conformi senza perdere i dati

La Google Consent Mode v2 (obbligatoria per tutti i tag Google dal marzo 2024) permette di operare anche quando l'utente rifiuta i cookie, attraverso la modellizzazione statistica del comportamento degli utenti che non hanno prestato consenso.

Implementazione corretta:

- CMP (Consent Management Platform) certificata IAB TCF 2.2 configurata correttamente

- Tag Manager configurato per passare i segnali di consenso alla Consent Mode

- Analytics configurato in modalità senza personalization per gli utenti senza consenso

- Documentazione del consenso registrata per ogni utente: data, versione del banner, scelte espresse

Ho verificato in più audit che la Consent Mode è spesso implementata tecnicamente ma non configurata per rispettare i requisiti del Garante italiano: i segnali di consenso passati al tag manager non corrispondono alle categorie del banner visibile all'utente. Questo configura un'implementazione non conforme nonostante l'apparenza di correttezza.

Email marketing B2B e B2C: le regole dopo gli ultimi provvedimenti del Garante

Il Garante italiano ha intensificato i controlli sulle pratiche di email marketing, con sanzioni specifiche per:

- Assenza di double opt-in documentato: il consenso deve essere tracciato con timestamp e indirizzo IP

- Mancato funzionamento del link di disiscrizione: obbligatorio in ogni email commerciale (Art. 130 D.Lgs. 196/2003)

- Liste acquistate senza catena del consenso verificabile: il titolare che acquista liste non può dimostrare il consenso specifico

- Email a indirizzi personali B2B senza consenso preventivo:

nome.cognome@azienda.itè dato personale soggetto al consenso

Per le cold email B2B verso indirizzi generici (info@, sales@), l'orientamento del Garante richiede almeno un'informativa preventiva ex Art. 14 GDPR e un meccanismo di opt-out funzionante.

Qual è il ruolo del DPO per le startup tecnologiche e quando è obbligatorio nominarlo?

Il Data Protection Officer (DPO / Responsabile della Protezione dei Dati) è obbligatorio per le organizzazioni che:

- Trattano dati su larga scala di categorie particolari (salute, biometria, opinioni politiche)

- Effettuano monitoraggio regolare e sistematico di persone fisiche su larga scala

- Sono enti pubblici o esercitano funzioni pubbliche

Per le startup SaaS, l'obbligo scatta quando il modello di business implica per definizione trattamenti su larga scala: una piattaforma HR tech che tratta dati di migliaia di candidati, o un'app di salute che raccoglie dati biometrici, rientra nell'obbligo.

Perché anche quando non è obbligatorio il DPO è un asset strategico:

- Due diligence investment: i fondi chiedono la figura del DPO come indicatore di maturità compliance

- Enterprise sales: i grandi clienti richiedono un referente DPO come punto di contatto per i data breach

- Gestione degli incidenti: un DPO esterno risponde entro la finestra delle 72 ore senza sovraccaricare il team tecnico

- Rappresentante UE per aziende extra-UE: le startup con sede fuori dall'UE che trattano dati di cittadini europei devono nominare un rappresentante nell'UE (Art. 27 GDPR)

Nota per startup extra-UE che vendono in Italia: se la startup è costituita fuori dallo Spazio Economico Europeo ma offre servizi a utenti europei o monitora il loro comportamento, si applica il GDPR per effetto dell'Art. 3(2). L'obbligo di nominare un rappresentante nell'UE è distinto dall'obbligo di DPO ma spesso confuso con esso.

Cosa significa privacy by design per una startup che sviluppa software dal codice?

Il principio di privacy by design e by default (Art. 25 GDPR) impone che la protezione dei dati sia integrata nello sviluppo del prodotto fin dalle prime fasi architetturali, non aggiunta come layer documentale a posteriori.

Per uno sviluppatore o un CTO, privacy by design si traduce in scelte tecniche concrete:

| Principio | Implementazione tecnica |

|---|---|

| Minimizzazione | Raccogliere solo i dati strettamente necessari per ogni feature. No a form con campi opzionali che diventano obbligatori de facto. |

| Pseudonimizzazione | Separare i dati identificativi dai dati comportamentali nei database. Tokenizzazione degli ID utente nei log. |

| Crittografia | TLS 1.3 per i dati in transito. Crittografia AES-256 per i dati at rest nei database. |

| Controllo degli accessi | RBAC (Role-Based Access Control): ogni team accede solo ai dati necessari per la propria funzione. |

| Data retention automatica | Job schedulati che cancellano i dati scaduti automaticamente secondo i periodi definiti nella privacy policy. |

| Portabilità nativa | API di export dati in formato strutturato (JSON, CSV) per le DSAR automatizzate. |

La conformità all'Art. 25 GDPR richiede che queste scelte siano documentate: le decisioni architetturali devono essere tracciate e giustificate rispetto ai principi GDPR, costituendo evidenza per eventuali audit.

Domande Frequenti (FAQ)

Una startup SaaS con sede a Londra (UK) dopo Brexit deve applicare il GDPR? Sì, se tratta dati di utenti o clienti nell'UE. L'Art. 3(2) GDPR ha effetto extraterritoriale: si applica a qualsiasi organizzazione che offra beni o servizi a soggetti nell'UE, indipendentemente dalla sede. Il UK ha adottato il proprio UK GDPR post-Brexit, ma per i trattamenti relativi a soggetti nell'UE rimane applicabile il GDPR europeo. Occorre verificare anche l'obbligo di nominare un rappresentante nell'UE ex Art. 27 GDPR.

L'ISO 27001 è sufficiente per dimostrare la conformità GDPR? No. La certificazione ISO 27001 attesta il sistema di gestione della sicurezza delle informazioni, non la conformità GDPR. Tuttavia, avere ISO 27001 è fortemente correlato a molti requisiti dell'Art. 32 GDPR (misure di sicurezza tecniche e organizzative) e facilita enormemente la compliance documentale. Per l'AI Act, la ISO/IEC 42001:2023 per i sistemi di gestione dell'intelligenza artificiale è il riferimento analogo.

Una piattaforma SaaS B2B deve nominare un DPO se ha solo 20 clienti aziendali? Dipende non dal numero di clienti ma dalle caratteristiche dei trattamenti. Se la piattaforma tratta dati personali di dipendenti dei 20 clienti su larga scala (migliaia di interessati), tratta categorie particolari di dati, o effettua profilazione sistematica, l'obbligo può scattare indipendentemente dal numero di clienti. Il parametro è la natura e la scala del trattamento, non le dimensioni del fatturato.

Cosa succede se un sistema AI sviluppato da una startup viene riclassificato come "alto rischio" dall'AI Act dopo il lancio? La startup (Provider) ha l'obbligo di riesaminare la classificazione ogni volta che modifica sostanzialmente il sistema (Art. 6 AI Act). Se una modifica comporta la riclassificazione ad alto rischio, si applicano i nuovi obblighi con un periodo di adeguamento. L'AI Act prevede aggiornamenti periodici degli Allegati da parte della Commissione: il monitoraggio della classificazione è un obbligo continuativo, non una valutazione una-tantum.

Come si dimostra la compliance GDPR e AI Act durante una due diligence da parte di un fondo? I fondi richiedono solitamente: (1) registro dei trattamenti aggiornato; (2) DPA con tutti i clienti B2B; (3) lista dei sub-processori con DPA firmati; (4) privacy policy e cookie policy aggiornate; (5) documentazione DPIA per i trattamenti ad alto rischio; (6) procedura di notifica data breach; (7) per sistemi AI: classificazione del rischio documentata e, per i sistemi ad alto rischio, documentazione tecnica ex Art. 11 AI Act. La presenza di un DPO nominato o di un consulente esterno incaricato è considerato un segnale positivo di maturità.

Conformità GDPR e AI Act per la tua startup: quando è utile un confronto professionale

Le informazioni contenute in questo articolo hanno carattere informativo e non costituiscono consulenza legale. Ogni startup, software house o agenzia digitale ha una propria architettura di trattamenti dati, una propria catena contrattuale con i clienti e proprie caratteristiche dei sistemi AI sviluppati o integrati. La valutazione della conformità richiede l'analisi del caso specifico, non l'applicazione di checklist generiche. Un audit iniziale della situazione documentale consente di identificare le priorità e di strutturare un percorso di adeguamento sostenibile.

Disclaimer deontologico: Questo articolo ha finalità informative generali e non costituisce parere legale né consulenza professionale. Il contenuto rispecchia il quadro normativo vigente alla data di pubblicazione. Per valutare la conformità della propria organizzazione al GDPR e all'AI Act, è necessaria una consulenza individuale che analizzi la situazione specifica. L'autore opera prevalentemente nel settore del diritto delle nuove tecnologie, della protezione dei dati personali e della compliance normativa per aziende tech e startup.

Autore

Avvocato iscritto all'Ordine di Sciacca (n. 747), specializzato in diritto delle tecnologie e privacy. Prima dell'attività forense ha sviluppato applicazioni web e architetture cloud, competenza che porta nell'analisi tecnico-giuridica di prodotti digitali, SaaS e sistemi AI. Assiste aziende e startup nell'adeguamento a GDPR, AI Act, NIS2 e DORA.

Profilo completo e competenze